# Assignment 6 指南

## `******注意,实验结束请立即删除负载均衡器和所有云主机,节省费用******`

## `******注意2,实验未结束且短期内不会继续实验,也请删除负载均衡器和所有云主机。下次实验时重新创建******`

## `******提示:勤用保存镜像******`

## 实验内容

- 创建负载均衡器: `实验步骤 一)`

- 创建Flask App服务实例,并连接负载均衡器:`实验步骤 二)`

- 进行服务器压力测试: `实验步骤 三)`

## 实验要求

- 完成所有步骤,并在实验报告([模板下载](file/assignment6/学号-实验六.docx))中完成穿插在本指南中的作业1~作业4(只需要截图)。实验报告转成“学号-实验六.pdf”,并上传至http://113.31.104.68:3389/index.htm

- 实验报告上传deadline: `11月20日`

## 使用UCloud产品

云主机UHost、负载均衡ULB、私有网络VPC、基础网络UNet

## 需要权限

云主机UHost、负载均衡ULB、基础网络UNet

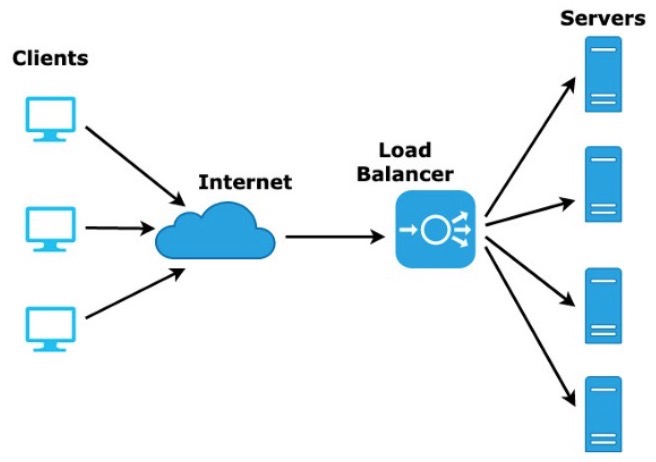

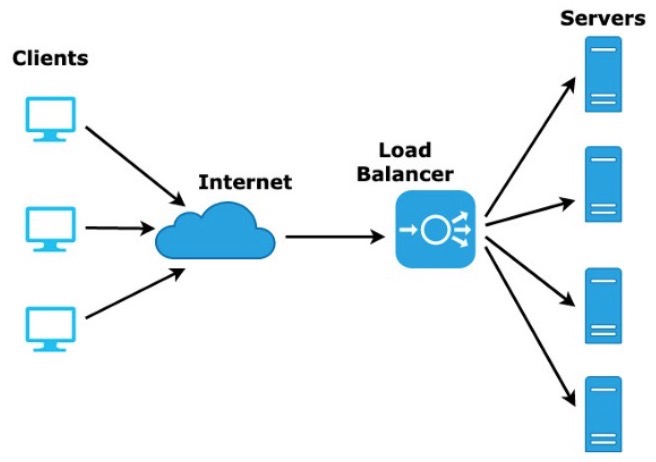

## 基础知识

`负载均衡:` load balancing,是指将用户请求按照一定的规则,分流到提供相同服务的多个服务实例上,从而减轻单点服务器的压力,是保证服务高并发高可用的技术手段之一。用户、负载均衡器和服务器实例的关系可以简化为下图。这种架构的另一个好处是可以把服务器隐藏在局域网防火墙背后,因为外网直接访问的是负载均衡器。

负载均衡的算法有很多,常见的如轮询,ip地址哈希,最小连接数等,应对不同的需求,感兴趣的同学可以去了解一下。

`压力测试:` 测试一个系统的最大抗压能力,在强负载、高并发的情况下,测试系统所能承受的最大压力,预估系统的瓶颈。例如天猫双11之前,阿里内部会对整个淘宝平台进行全链路压测,预估应对峰值交易的能力。压力测试的工具有很多,今天我们练习使用非常简单的ApacheBench(ab)对http服务器进行压测。

好,废话少说,咱们书归正传!

## 实验步骤

### 一)使用ULB创建一个外网负载均衡器。

#### 1)在产品->网络中选择负载均衡ULB,然后点击创建负载均衡。

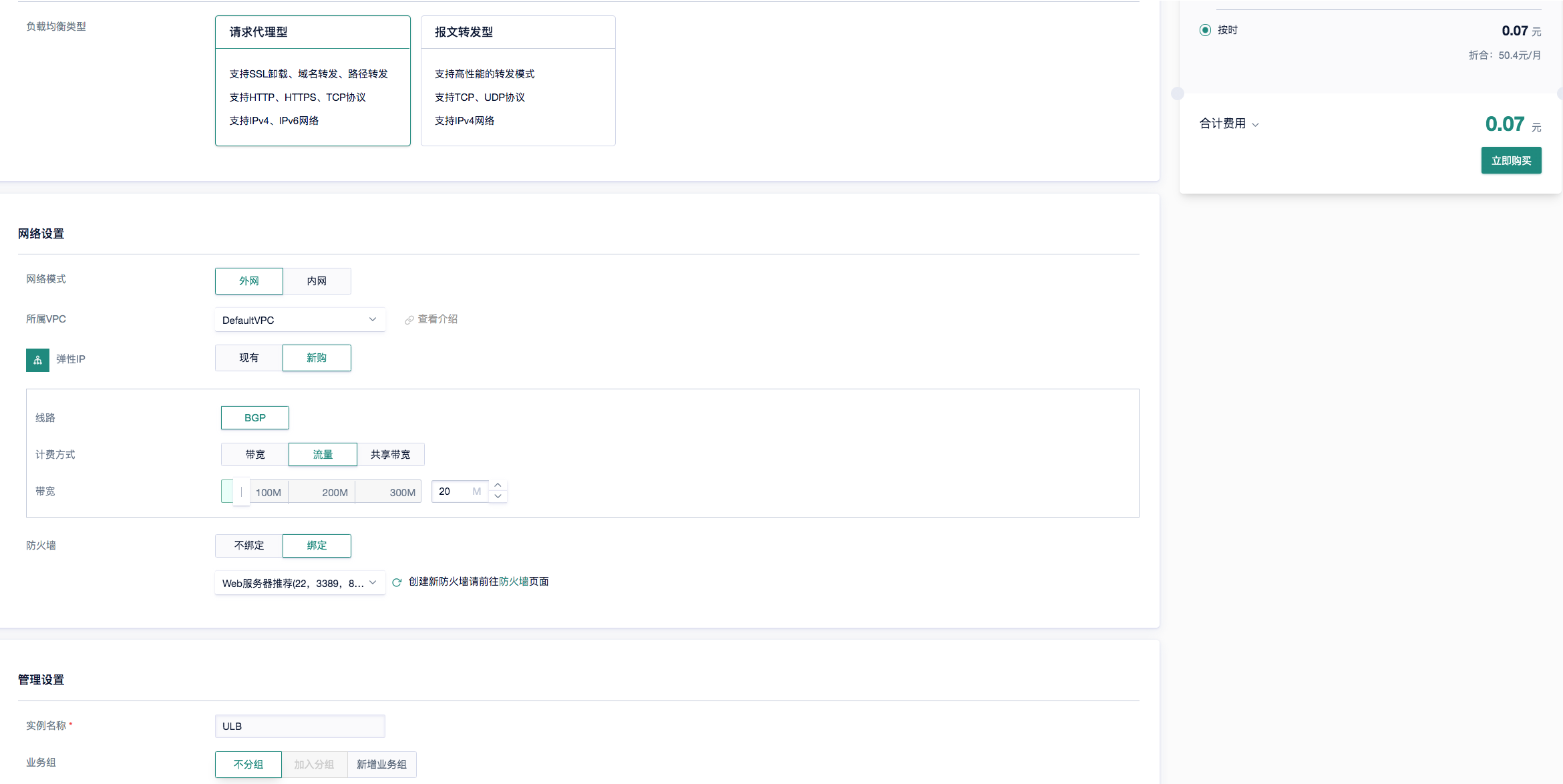

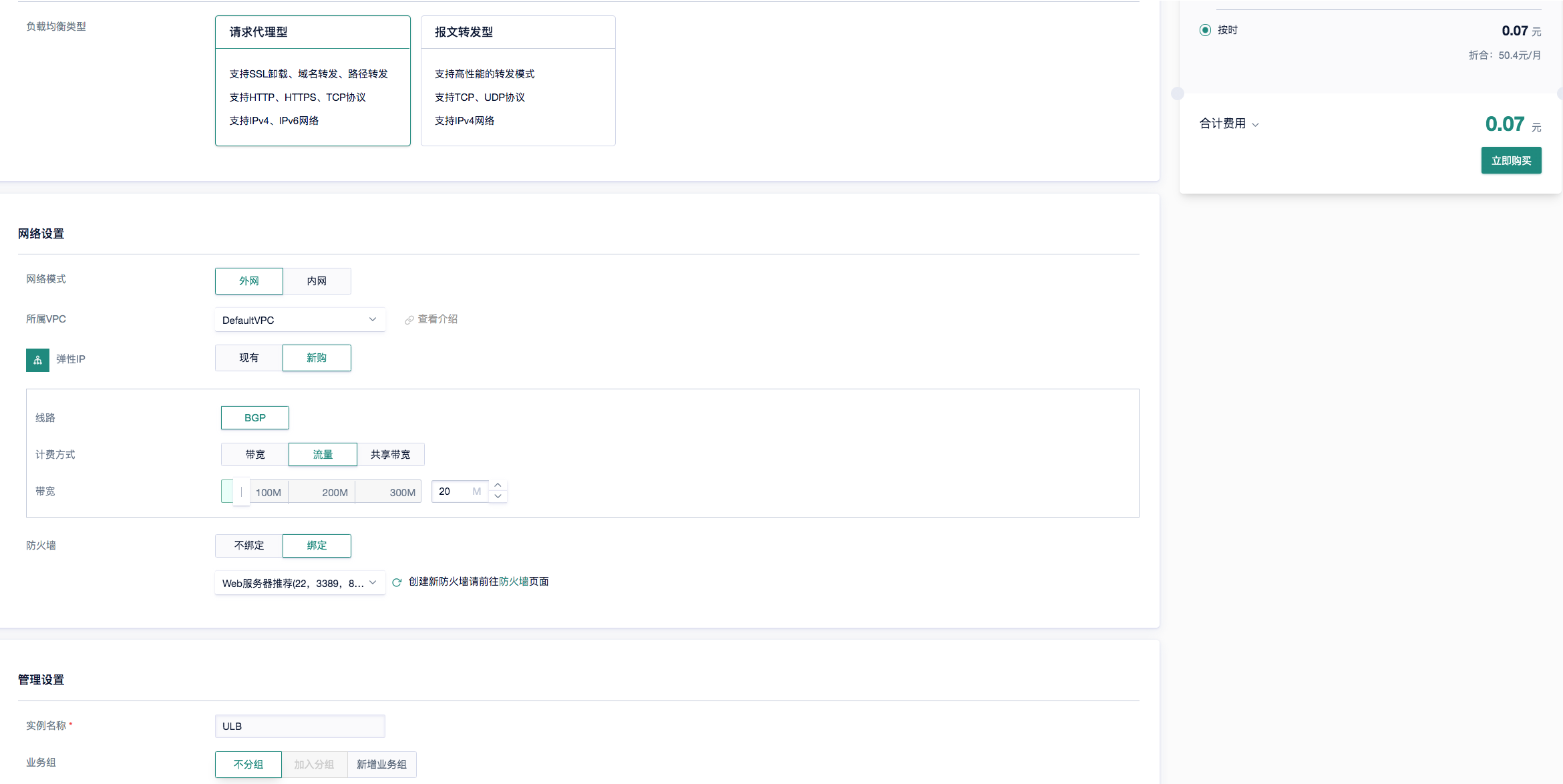

#### 2)根据下图配置,选择按时付费。因为我们一会需要从外网访问Flask App,所以选择外网负载均衡。

负载均衡的算法有很多,常见的如轮询,ip地址哈希,最小连接数等,应对不同的需求,感兴趣的同学可以去了解一下。

`压力测试:` 测试一个系统的最大抗压能力,在强负载、高并发的情况下,测试系统所能承受的最大压力,预估系统的瓶颈。例如天猫双11之前,阿里内部会对整个淘宝平台进行全链路压测,预估应对峰值交易的能力。压力测试的工具有很多,今天我们练习使用非常简单的ApacheBench(ab)对http服务器进行压测。

好,废话少说,咱们书归正传!

## 实验步骤

### 一)使用ULB创建一个外网负载均衡器。

#### 1)在产品->网络中选择负载均衡ULB,然后点击创建负载均衡。

#### 2)根据下图配置,选择按时付费。因为我们一会需要从外网访问Flask App,所以选择外网负载均衡。

#### 3)创建完毕后,记住ULB的IP地址,点击详情->VServer管理->添加VServer。这里VServer就可以看成是一个负载均衡服务器,负责分流。取任意VServer名称,其他保持默认设置,点击确定。

#### 3)创建完毕后,记住ULB的IP地址,点击详情->VServer管理->添加VServer。这里VServer就可以看成是一个负载均衡服务器,负责分流。取任意VServer名称,其他保持默认设置,点击确定。

#### 4)点击“服务节点”标签页,当前没有任务实际的节点提供服务。我们接下来创建一些服务节点。

### 二)使用云主机创建Flask App服务实例,并连接负载均衡器。

#### 1)创建一个1核1G的云主机,绑定弹性IP,选择web型防火墙,按时付费(已经很熟练了吧 :dog: :dog:)

#### 2)使用docker file创建一个Flask App的image(比如实验2中的hello world),并且暴露docker容器的5000端口(因为Flask开发模式默认端口就是5000)。创建完毕之后运行docker,将5000端口映射到云主机的80端口。

```

docker run -d --rm -p 80:5000 -name myflask luxuesong/myflaskapp

```

请同学们复习一下docker的安装和使用,以及通过dockerfile创建镜像。如果你意外保存了实验二的镜像,可以从镜像创建云主机,然后直接启动并docker run。

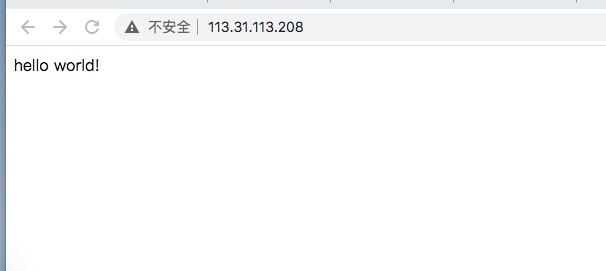

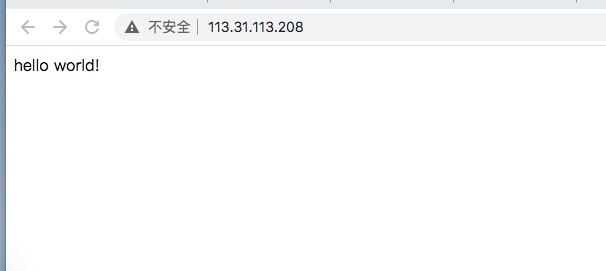

#### 3)打开浏览器,输入 `http://你的云主机外网ip`,测试app是否正常运行。正常则进入下一步。

#### 4)点击“服务节点”标签页,当前没有任务实际的节点提供服务。我们接下来创建一些服务节点。

### 二)使用云主机创建Flask App服务实例,并连接负载均衡器。

#### 1)创建一个1核1G的云主机,绑定弹性IP,选择web型防火墙,按时付费(已经很熟练了吧 :dog: :dog:)

#### 2)使用docker file创建一个Flask App的image(比如实验2中的hello world),并且暴露docker容器的5000端口(因为Flask开发模式默认端口就是5000)。创建完毕之后运行docker,将5000端口映射到云主机的80端口。

```

docker run -d --rm -p 80:5000 -name myflask luxuesong/myflaskapp

```

请同学们复习一下docker的安装和使用,以及通过dockerfile创建镜像。如果你意外保存了实验二的镜像,可以从镜像创建云主机,然后直接启动并docker run。

#### 3)打开浏览器,输入 `http://你的云主机外网ip`,测试app是否正常运行。正常则进入下一步。

#### 4)将云主机连到负载均衡器。回到前面添加服务节点的界面,输入端口80,则所有可添加的节点都会出现(以内网ip形式)。将你的云主机对应的内网ip,转移到待添加节点,点击确定。这时候显示健康检查“失败”,不用管它,我们在浏览器中输入 `http://你的负载均衡器ip`,奇迹发生了!我们也能访问flask app!!并且这时候健康检查也变成“正常”。

#### 4)将云主机连到负载均衡器。回到前面添加服务节点的界面,输入端口80,则所有可添加的节点都会出现(以内网ip形式)。将你的云主机对应的内网ip,转移到待添加节点,点击确定。这时候显示健康检查“失败”,不用管它,我们在浏览器中输入 `http://你的负载均衡器ip`,奇迹发生了!我们也能访问flask app!!并且这时候健康检查也变成“正常”。

#### 5)此时负载均衡器只连接了一个服务实例,等同于单机访问。`为步骤三做准备,请在这一步制作当前云主机的镜像`。

### 三)使用ab进行http服务器压力测试

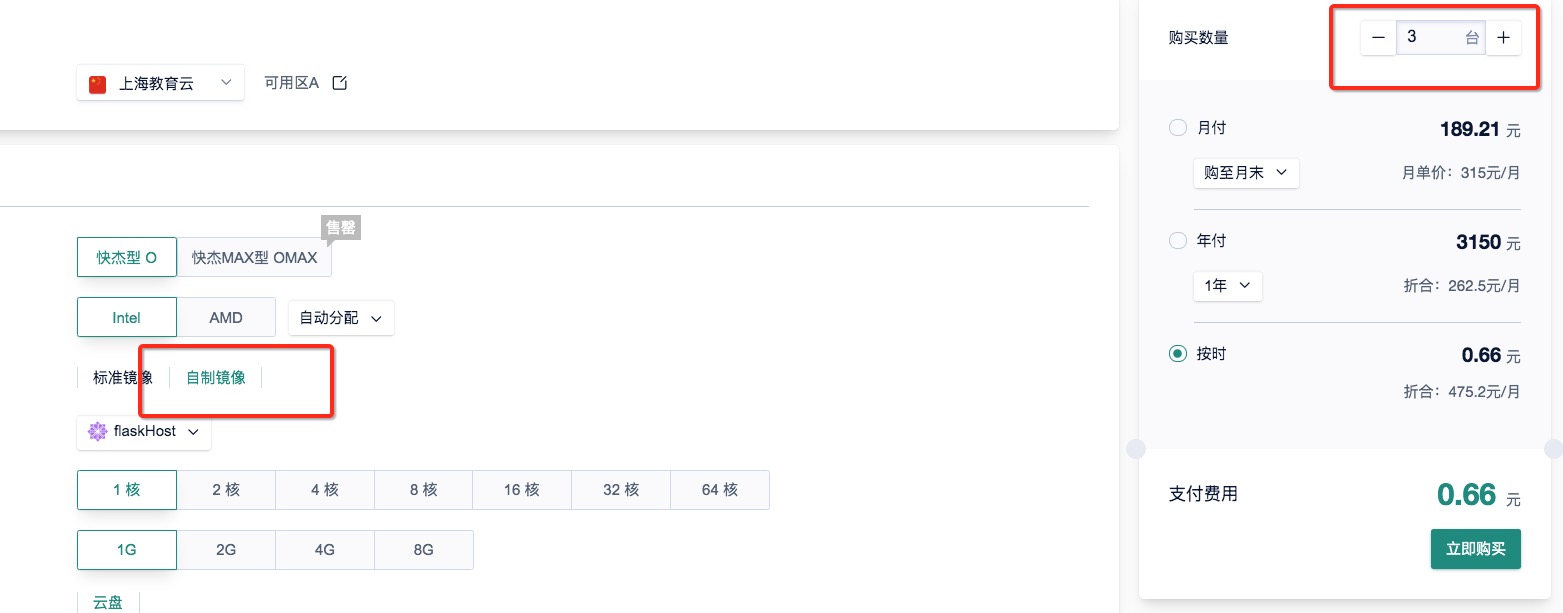

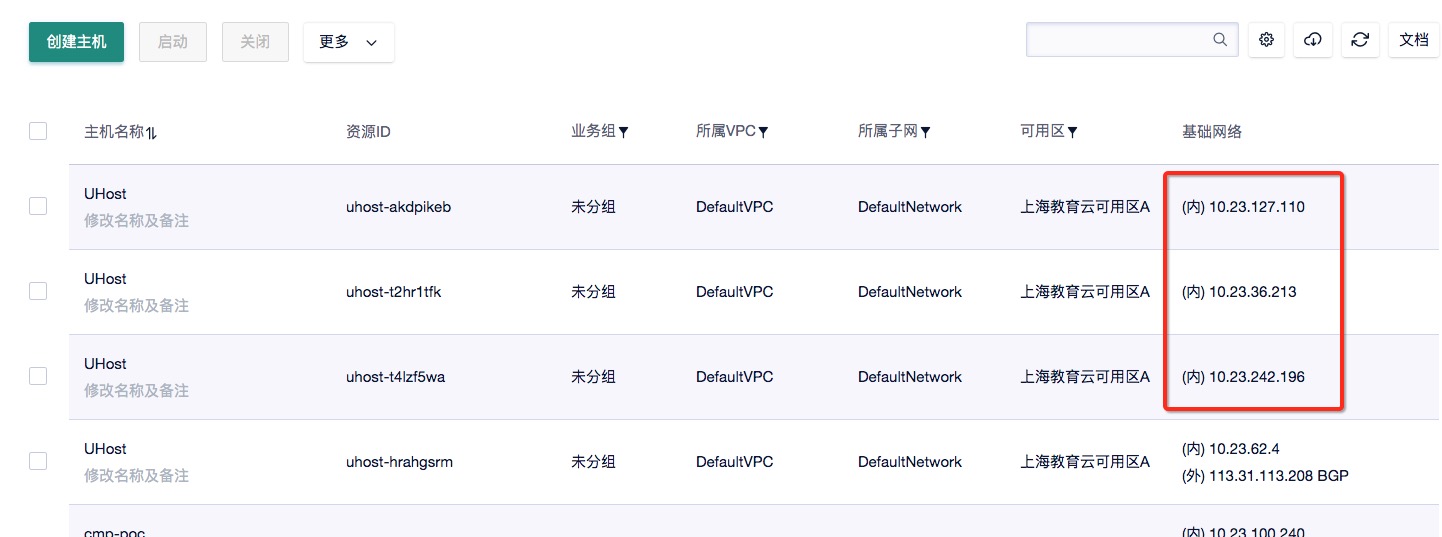

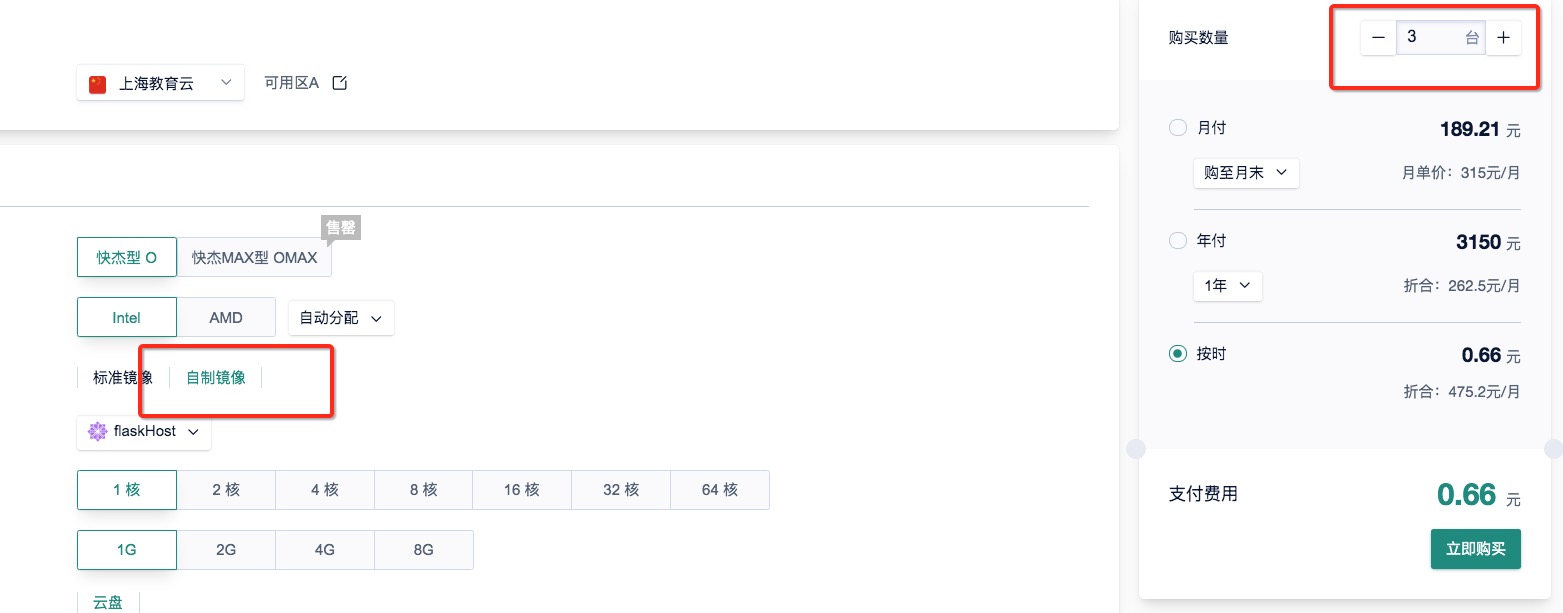

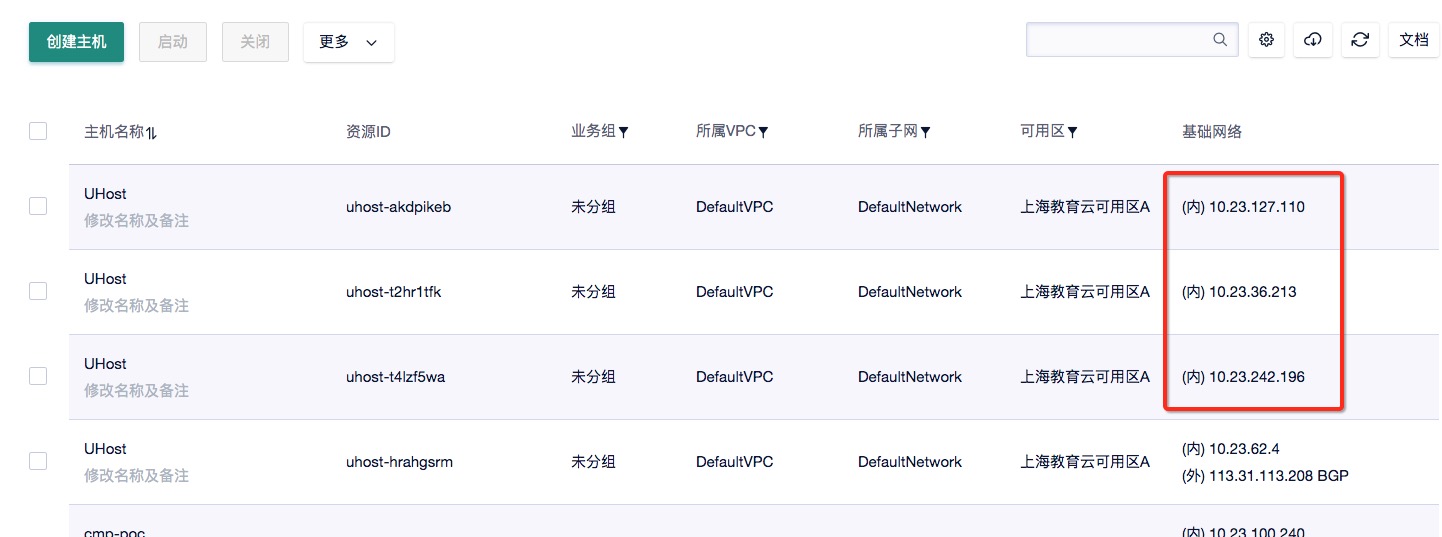

#### 1)使用步骤二)中制作的镜像,创建三个最低配置的云主机(`和之前一样,只是在云主机创建界面用“自制镜像”,并且不需要弹性ip`),可以选择三台主机一次性创建

#### 5)此时负载均衡器只连接了一个服务实例,等同于单机访问。`为步骤三做准备,请在这一步制作当前云主机的镜像`。

### 三)使用ab进行http服务器压力测试

#### 1)使用步骤二)中制作的镜像,创建三个最低配置的云主机(`和之前一样,只是在云主机创建界面用“自制镜像”,并且不需要弹性ip`),可以选择三台主机一次性创建

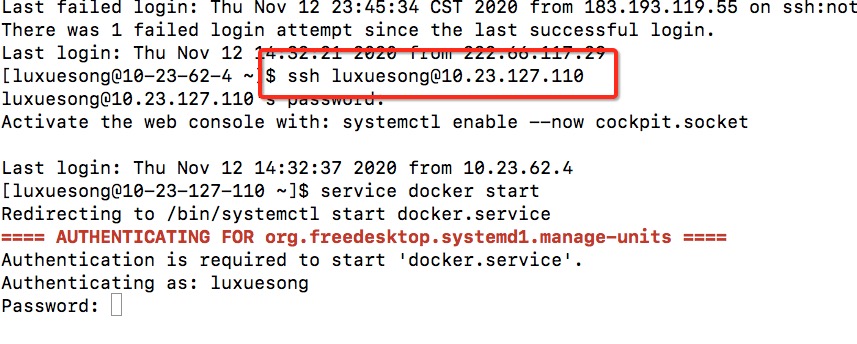

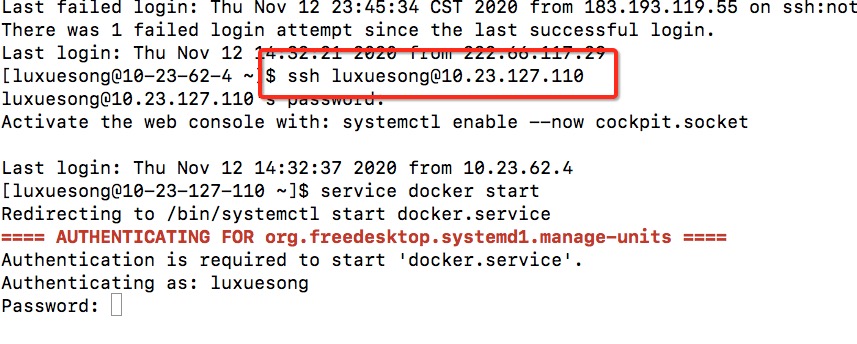

#### 2)创建完毕后,使用有外网ip的那台云主机,逐个ssh到三台内网机器上(通过内网ip),然后每台机器直接启动docker服务,并运行flask app容器(因为已经全都安装并且build好了 :smiley_cat: :smiley_cat: :smiley_cat:)

#### 2)创建完毕后,使用有外网ip的那台云主机,逐个ssh到三台内网机器上(通过内网ip),然后每台机器直接启动docker服务,并运行flask app容器(因为已经全都安装并且build好了 :smiley_cat: :smiley_cat: :smiley_cat:)

##### 1.1)安装完毕后运行以下命令登录数据仓库。将相关参数替换成你的数据仓库参数。登录后将看到如下界面(我们已经在dev库中)。

```

psql -h hostIP –U username -d database -p port

```

## `**************作业1:请将登录命令和登录成功界面截图,并插入实验报告***************`

##### 1.2)让我们运行几个SQL代码来实现建表,插入,查询等操作。

> 复制以下sql代码,并在psql中运行(注意要包含最后的分号)

```

CREATE TABLE regression (

id int,

y int,

x1 int,

x2 int

);

```

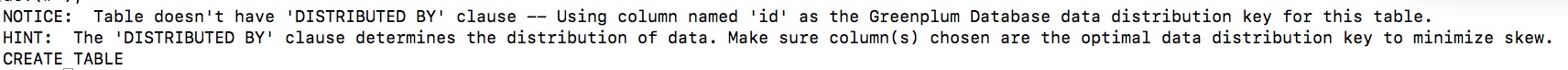

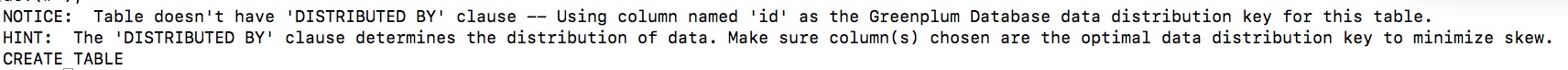

> 运行后我们看到如下notice,提示建表时没有使用`DISTRIBUTED BY`语句,因此Greenplum默认使用id作为分布键。这是因为greenplum是一个分布式数仓,数据会分布在不同的节点上,因此建表的时候要用`DISTRIBUTED BY`语句说明按照哪一个属性(即所谓“分布键”)对数据进行划分。由于我们没有指定,系统默认使用了第一列作为分布键。

##### 1.1)安装完毕后运行以下命令登录数据仓库。将相关参数替换成你的数据仓库参数。登录后将看到如下界面(我们已经在dev库中)。

```

psql -h hostIP –U username -d database -p port

```

## `**************作业1:请将登录命令和登录成功界面截图,并插入实验报告***************`

##### 1.2)让我们运行几个SQL代码来实现建表,插入,查询等操作。

> 复制以下sql代码,并在psql中运行(注意要包含最后的分号)

```

CREATE TABLE regression (

id int,

y int,

x1 int,

x2 int

);

```

> 运行后我们看到如下notice,提示建表时没有使用`DISTRIBUTED BY`语句,因此Greenplum默认使用id作为分布键。这是因为greenplum是一个分布式数仓,数据会分布在不同的节点上,因此建表的时候要用`DISTRIBUTED BY`语句说明按照哪一个属性(即所谓“分布键”)对数据进行划分。由于我们没有指定,系统默认使用了第一列作为分布键。

> 接着让我们在regression表中插入一些值

```

INSERT INTO regression VALUES

(1, 5, 2, 3),

(2, 10, 7, 2),

(3, 6, 4, 1),

(4, 8, 3, 4);

```

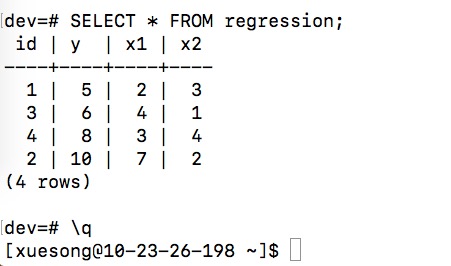

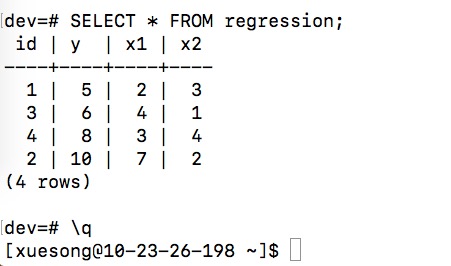

> 让我们查询一下regression表中的数据。你应该看到如下输出。

```

SELECT * FROM regression;

```

> 接着让我们在regression表中插入一些值

```

INSERT INTO regression VALUES

(1, 5, 2, 3),

(2, 10, 7, 2),

(3, 6, 4, 1),

(4, 8, 3, 4);

```

> 让我们查询一下regression表中的数据。你应该看到如下输出。

```

SELECT * FROM regression;

```

##### 1.3)运行\q退出psql客户端。

## `**************作业2:请如上图一样将regression表的查询命令、输出结果和退出psql以后的界面截图,并插入实验报告***************`

#### 2)使用`Python`+`psycopg2`访问。很多时候我们需要在程序中访问数据仓库,比如用Python读取DW中的数据,然后进一步操作。我们可以通过使用`psycopg2`来实现访问。运行以下命令安装`psycopg2`package。

```

sudo yum install python3-devel -y

sudo yum install postgresql-libs -y

sudo yum install postgresql-devel -y

sudo yum install gcc -y

pip3 install --user psycopg2

```

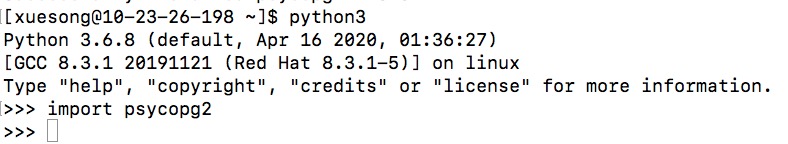

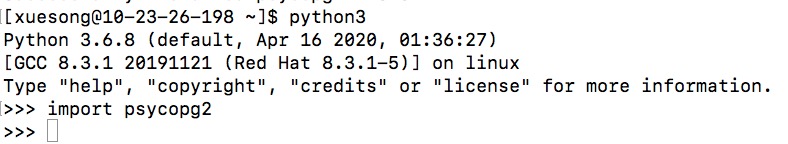

##### 2.1)安装完毕后运行python3,然后import psycopg2,若没有报错,则说明psycopg2安装成功。

##### 1.3)运行\q退出psql客户端。

## `**************作业2:请如上图一样将regression表的查询命令、输出结果和退出psql以后的界面截图,并插入实验报告***************`

#### 2)使用`Python`+`psycopg2`访问。很多时候我们需要在程序中访问数据仓库,比如用Python读取DW中的数据,然后进一步操作。我们可以通过使用`psycopg2`来实现访问。运行以下命令安装`psycopg2`package。

```

sudo yum install python3-devel -y

sudo yum install postgresql-libs -y

sudo yum install postgresql-devel -y

sudo yum install gcc -y

pip3 install --user psycopg2

```

##### 2.1)安装完毕后运行python3,然后import psycopg2,若没有报错,则说明psycopg2安装成功。

##### 2.2)quit()退出python3命令行,让我们运行几个Python代码来实现建表,插入,查询等操作。

> 建立createTable.py文件,并复制如下代码。其中username,password,hostIP,port都要替换成你的数据仓库参数。

```

import psycopg2

conn = psycopg2.connect(database="dev", user="username", password="password", host="hostIP", port="port")

cur = conn.cursor()

cur.execute('CREATE TABLE COMPANY (ID INT PRIMARY KEY NOT NULL,\

NAME TEXT NOT NULL,\

AGE INT NOT NULL,\

ADDRESS CHAR(10),\

SALARY REAL);')

conn.commit()

conn.close()

```

> 运行createTable.py,如果没有报错,则说明建表成功。

```

python3 createTable.py

```

> 向COMPANY表中添加一些记录。建立insertTable.py文件,复制如下代码并运行。

```

import psycopg2

conn = psycopg2.connect(database="dev", user="username", password="password", host="hostIP", port="port")

cur = conn.cursor()

cur.execute("INSERT INTO COMPANY VALUES (1, 'Paul', 32, 'California', 20000.00 )");

cur.execute("INSERT INTO COMPANY VALUES (2, 'Allen', 25, 'Texas', 15000.00 )");

cur.execute("INSERT INTO COMPANY VALUES (3, 'Eric', 35, 'Florida', 25000.00 )");

conn.commit()

conn.close()

```

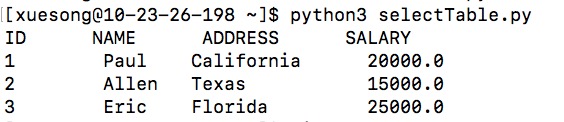

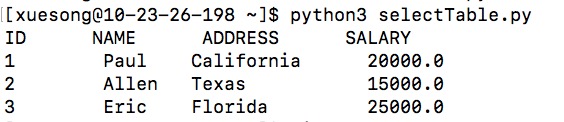

> 让我们查询一下刚刚建的表。建立selectTable.py文件,复制如下代码并运行。

```

import psycopg2

conn = psycopg2.connect(database="dev", user="username", password="password", host="hostIP", port="port")

cur = conn.cursor()

cur.execute("SELECT id, name, address, salary from COMPANY order by id")

rows = cur.fetchall()

print ("ID NAME ADDRESS SALARY")

for row in rows:

print (row[0], "\t", row[1], "\t", row[2], "\t", row[3])

conn.close()

```

> 你应该会看到如下输出。

##### 2.2)quit()退出python3命令行,让我们运行几个Python代码来实现建表,插入,查询等操作。

> 建立createTable.py文件,并复制如下代码。其中username,password,hostIP,port都要替换成你的数据仓库参数。

```

import psycopg2

conn = psycopg2.connect(database="dev", user="username", password="password", host="hostIP", port="port")

cur = conn.cursor()

cur.execute('CREATE TABLE COMPANY (ID INT PRIMARY KEY NOT NULL,\

NAME TEXT NOT NULL,\

AGE INT NOT NULL,\

ADDRESS CHAR(10),\

SALARY REAL);')

conn.commit()

conn.close()

```

> 运行createTable.py,如果没有报错,则说明建表成功。

```

python3 createTable.py

```

> 向COMPANY表中添加一些记录。建立insertTable.py文件,复制如下代码并运行。

```

import psycopg2

conn = psycopg2.connect(database="dev", user="username", password="password", host="hostIP", port="port")

cur = conn.cursor()

cur.execute("INSERT INTO COMPANY VALUES (1, 'Paul', 32, 'California', 20000.00 )");

cur.execute("INSERT INTO COMPANY VALUES (2, 'Allen', 25, 'Texas', 15000.00 )");

cur.execute("INSERT INTO COMPANY VALUES (3, 'Eric', 35, 'Florida', 25000.00 )");

conn.commit()

conn.close()

```

> 让我们查询一下刚刚建的表。建立selectTable.py文件,复制如下代码并运行。

```

import psycopg2

conn = psycopg2.connect(database="dev", user="username", password="password", host="hostIP", port="port")

cur = conn.cursor()

cur.execute("SELECT id, name, address, salary from COMPANY order by id")

rows = cur.fetchall()

print ("ID NAME ADDRESS SALARY")

for row in rows:

print (row[0], "\t", row[1], "\t", row[2], "\t", row[3])

conn.close()

```

> 你应该会看到如下输出。

## `**************作业3:请将运行selectTable.py的命令和输出结果截图,并插入实验报告***************`

### 三)使用MADlib完成简单的机器学习任务(线性回归)

#### 1)前面我们说过,在Greenplum中使用MADlib插件可以直接在DW中建立机器学习模型。这里我们用二)中的regression表跑一下线性回归算法。请使用psql或者psycopg2登录数仓,并运行如下命令。

```

SELECT madlib.linregr_train (

'regression', -- source table

'regression_model', -- output model table

'y', -- dependent variable

'ARRAY[1, x1, x2]' -- independent variables

);

```

> 这里我们看到使用了MADlib的线性回归模型linregr_train来对regression表中的数据进行训练,模型输入变量为x1, x2以及偏置项,输出变量为y。训练好的模型保存在regression_model表中。

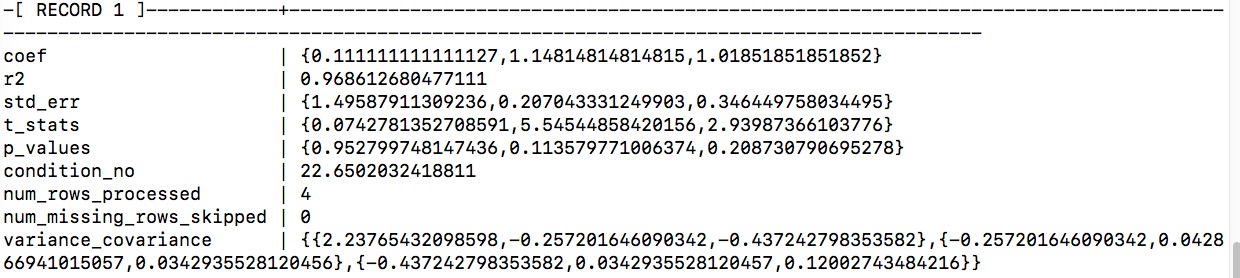

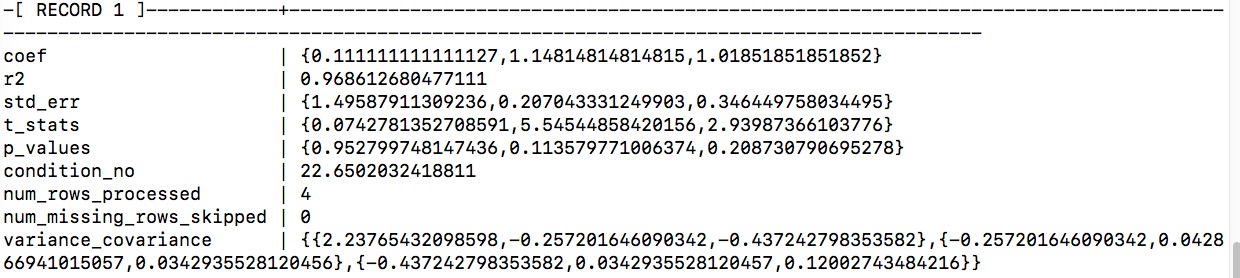

### 2)让我们看下模型表中有什么,运行以下命令

```

SELECT * FROM regression_model;

```

> 可能输出比较乱,你可以运行以下命令,让表的结果竖起来。

```

\x

SELECT * FROM regression_model;

```

> 这样是不是顺眼多了 :ghost: :ghost: :ghost: 我们看到了线性回归模型的参数以及标准差,p-value等指标的值

## `**************作业3:请将运行selectTable.py的命令和输出结果截图,并插入实验报告***************`

### 三)使用MADlib完成简单的机器学习任务(线性回归)

#### 1)前面我们说过,在Greenplum中使用MADlib插件可以直接在DW中建立机器学习模型。这里我们用二)中的regression表跑一下线性回归算法。请使用psql或者psycopg2登录数仓,并运行如下命令。

```

SELECT madlib.linregr_train (

'regression', -- source table

'regression_model', -- output model table

'y', -- dependent variable

'ARRAY[1, x1, x2]' -- independent variables

);

```

> 这里我们看到使用了MADlib的线性回归模型linregr_train来对regression表中的数据进行训练,模型输入变量为x1, x2以及偏置项,输出变量为y。训练好的模型保存在regression_model表中。

### 2)让我们看下模型表中有什么,运行以下命令

```

SELECT * FROM regression_model;

```

> 可能输出比较乱,你可以运行以下命令,让表的结果竖起来。

```

\x

SELECT * FROM regression_model;

```

> 这样是不是顺眼多了 :ghost: :ghost: :ghost: 我们看到了线性回归模型的参数以及标准差,p-value等指标的值

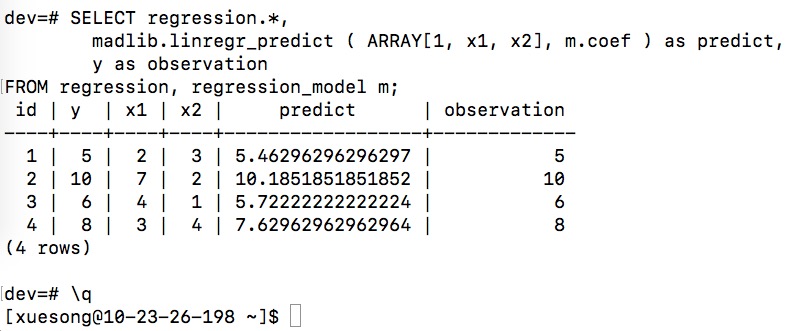

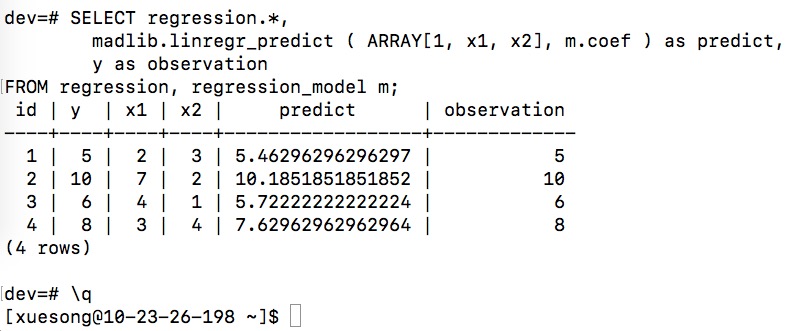

### 3)最后让我们用这个模型去做预测。我们直接在训练集上进行预测。你会看到如下输出,其中predict是预测结果,observation是原始的y值。

```

\x

SELECT regression.*,

madlib.linregr_predict ( ARRAY[1, x1, x2], m.coef ) as predict,

y as observation

FROM regression, regression_model m;

```

### 3)最后让我们用这个模型去做预测。我们直接在训练集上进行预测。你会看到如下输出,其中predict是预测结果,observation是原始的y值。

```

\x

SELECT regression.*,

madlib.linregr_predict ( ARRAY[1, x1, x2], m.coef ) as predict,

y as observation

FROM regression, regression_model m;

```

### 4)运行\q退出psql客户端。

## `**************作业4:请如上图一样把预测结果和退出psql以后的界面一起截图,并插入实验报告***************`

### 4)运行\q退出psql客户端。

## `**************作业4:请如上图一样把预测结果和退出psql以后的界面一起截图,并插入实验报告***************`

负载均衡的算法有很多,常见的如轮询,ip地址哈希,最小连接数等,应对不同的需求,感兴趣的同学可以去了解一下。

`压力测试:` 测试一个系统的最大抗压能力,在强负载、高并发的情况下,测试系统所能承受的最大压力,预估系统的瓶颈。例如天猫双11之前,阿里内部会对整个淘宝平台进行全链路压测,预估应对峰值交易的能力。压力测试的工具有很多,今天我们练习使用非常简单的ApacheBench(ab)对http服务器进行压测。

好,废话少说,咱们书归正传!

## 实验步骤

### 一)使用ULB创建一个外网负载均衡器。

#### 1)在产品->网络中选择负载均衡ULB,然后点击创建负载均衡。

#### 2)根据下图配置,选择按时付费。因为我们一会需要从外网访问Flask App,所以选择外网负载均衡。

负载均衡的算法有很多,常见的如轮询,ip地址哈希,最小连接数等,应对不同的需求,感兴趣的同学可以去了解一下。

`压力测试:` 测试一个系统的最大抗压能力,在强负载、高并发的情况下,测试系统所能承受的最大压力,预估系统的瓶颈。例如天猫双11之前,阿里内部会对整个淘宝平台进行全链路压测,预估应对峰值交易的能力。压力测试的工具有很多,今天我们练习使用非常简单的ApacheBench(ab)对http服务器进行压测。

好,废话少说,咱们书归正传!

## 实验步骤

### 一)使用ULB创建一个外网负载均衡器。

#### 1)在产品->网络中选择负载均衡ULB,然后点击创建负载均衡。

#### 2)根据下图配置,选择按时付费。因为我们一会需要从外网访问Flask App,所以选择外网负载均衡。

#### 3)创建完毕后,记住ULB的IP地址,点击详情->VServer管理->添加VServer。这里VServer就可以看成是一个负载均衡服务器,负责分流。取任意VServer名称,其他保持默认设置,点击确定。

#### 3)创建完毕后,记住ULB的IP地址,点击详情->VServer管理->添加VServer。这里VServer就可以看成是一个负载均衡服务器,负责分流。取任意VServer名称,其他保持默认设置,点击确定。

#### 4)点击“服务节点”标签页,当前没有任务实际的节点提供服务。我们接下来创建一些服务节点。

### 二)使用云主机创建Flask App服务实例,并连接负载均衡器。

#### 1)创建一个1核1G的云主机,绑定弹性IP,选择web型防火墙,按时付费(已经很熟练了吧 :dog: :dog:)

#### 2)使用docker file创建一个Flask App的image(比如实验2中的hello world),并且暴露docker容器的5000端口(因为Flask开发模式默认端口就是5000)。创建完毕之后运行docker,将5000端口映射到云主机的80端口。

```

docker run -d --rm -p 80:5000 -name myflask luxuesong/myflaskapp

```

请同学们复习一下docker的安装和使用,以及通过dockerfile创建镜像。如果你意外保存了实验二的镜像,可以从镜像创建云主机,然后直接启动并docker run。

#### 3)打开浏览器,输入 `http://你的云主机外网ip`,测试app是否正常运行。正常则进入下一步。

#### 4)点击“服务节点”标签页,当前没有任务实际的节点提供服务。我们接下来创建一些服务节点。

### 二)使用云主机创建Flask App服务实例,并连接负载均衡器。

#### 1)创建一个1核1G的云主机,绑定弹性IP,选择web型防火墙,按时付费(已经很熟练了吧 :dog: :dog:)

#### 2)使用docker file创建一个Flask App的image(比如实验2中的hello world),并且暴露docker容器的5000端口(因为Flask开发模式默认端口就是5000)。创建完毕之后运行docker,将5000端口映射到云主机的80端口。

```

docker run -d --rm -p 80:5000 -name myflask luxuesong/myflaskapp

```

请同学们复习一下docker的安装和使用,以及通过dockerfile创建镜像。如果你意外保存了实验二的镜像,可以从镜像创建云主机,然后直接启动并docker run。

#### 3)打开浏览器,输入 `http://你的云主机外网ip`,测试app是否正常运行。正常则进入下一步。

#### 4)将云主机连到负载均衡器。回到前面添加服务节点的界面,输入端口80,则所有可添加的节点都会出现(以内网ip形式)。将你的云主机对应的内网ip,转移到待添加节点,点击确定。这时候显示健康检查“失败”,不用管它,我们在浏览器中输入 `http://你的负载均衡器ip`,奇迹发生了!我们也能访问flask app!!并且这时候健康检查也变成“正常”。

#### 4)将云主机连到负载均衡器。回到前面添加服务节点的界面,输入端口80,则所有可添加的节点都会出现(以内网ip形式)。将你的云主机对应的内网ip,转移到待添加节点,点击确定。这时候显示健康检查“失败”,不用管它,我们在浏览器中输入 `http://你的负载均衡器ip`,奇迹发生了!我们也能访问flask app!!并且这时候健康检查也变成“正常”。

#### 5)此时负载均衡器只连接了一个服务实例,等同于单机访问。`为步骤三做准备,请在这一步制作当前云主机的镜像`。

### 三)使用ab进行http服务器压力测试

#### 1)使用步骤二)中制作的镜像,创建三个最低配置的云主机(`和之前一样,只是在云主机创建界面用“自制镜像”,并且不需要弹性ip`),可以选择三台主机一次性创建

#### 5)此时负载均衡器只连接了一个服务实例,等同于单机访问。`为步骤三做准备,请在这一步制作当前云主机的镜像`。

### 三)使用ab进行http服务器压力测试

#### 1)使用步骤二)中制作的镜像,创建三个最低配置的云主机(`和之前一样,只是在云主机创建界面用“自制镜像”,并且不需要弹性ip`),可以选择三台主机一次性创建

#### 2)创建完毕后,使用有外网ip的那台云主机,逐个ssh到三台内网机器上(通过内网ip),然后每台机器直接启动docker服务,并运行flask app容器(因为已经全都安装并且build好了 :smiley_cat: :smiley_cat: :smiley_cat:)

#### 2)创建完毕后,使用有外网ip的那台云主机,逐个ssh到三台内网机器上(通过内网ip),然后每台机器直接启动docker服务,并运行flask app容器(因为已经全都安装并且build好了 :smiley_cat: :smiley_cat: :smiley_cat:)

##### 1.1)安装完毕后运行以下命令登录数据仓库。将相关参数替换成你的数据仓库参数。登录后将看到如下界面(我们已经在dev库中)。

```

psql -h hostIP –U username -d database -p port

```

## `**************作业1:请将登录命令和登录成功界面截图,并插入实验报告***************`

##### 1.2)让我们运行几个SQL代码来实现建表,插入,查询等操作。

> 复制以下sql代码,并在psql中运行(注意要包含最后的分号)

```

CREATE TABLE regression (

id int,

y int,

x1 int,

x2 int

);

```

> 运行后我们看到如下notice,提示建表时没有使用`DISTRIBUTED BY`语句,因此Greenplum默认使用id作为分布键。这是因为greenplum是一个分布式数仓,数据会分布在不同的节点上,因此建表的时候要用`DISTRIBUTED BY`语句说明按照哪一个属性(即所谓“分布键”)对数据进行划分。由于我们没有指定,系统默认使用了第一列作为分布键。

##### 1.1)安装完毕后运行以下命令登录数据仓库。将相关参数替换成你的数据仓库参数。登录后将看到如下界面(我们已经在dev库中)。

```

psql -h hostIP –U username -d database -p port

```

## `**************作业1:请将登录命令和登录成功界面截图,并插入实验报告***************`

##### 1.2)让我们运行几个SQL代码来实现建表,插入,查询等操作。

> 复制以下sql代码,并在psql中运行(注意要包含最后的分号)

```

CREATE TABLE regression (

id int,

y int,

x1 int,

x2 int

);

```

> 运行后我们看到如下notice,提示建表时没有使用`DISTRIBUTED BY`语句,因此Greenplum默认使用id作为分布键。这是因为greenplum是一个分布式数仓,数据会分布在不同的节点上,因此建表的时候要用`DISTRIBUTED BY`语句说明按照哪一个属性(即所谓“分布键”)对数据进行划分。由于我们没有指定,系统默认使用了第一列作为分布键。

> 接着让我们在regression表中插入一些值

```

INSERT INTO regression VALUES

(1, 5, 2, 3),

(2, 10, 7, 2),

(3, 6, 4, 1),

(4, 8, 3, 4);

```

> 让我们查询一下regression表中的数据。你应该看到如下输出。

```

SELECT * FROM regression;

```

> 接着让我们在regression表中插入一些值

```

INSERT INTO regression VALUES

(1, 5, 2, 3),

(2, 10, 7, 2),

(3, 6, 4, 1),

(4, 8, 3, 4);

```

> 让我们查询一下regression表中的数据。你应该看到如下输出。

```

SELECT * FROM regression;

```

##### 1.3)运行\q退出psql客户端。

## `**************作业2:请如上图一样将regression表的查询命令、输出结果和退出psql以后的界面截图,并插入实验报告***************`

#### 2)使用`Python`+`psycopg2`访问。很多时候我们需要在程序中访问数据仓库,比如用Python读取DW中的数据,然后进一步操作。我们可以通过使用`psycopg2`来实现访问。运行以下命令安装`psycopg2`package。

```

sudo yum install python3-devel -y

sudo yum install postgresql-libs -y

sudo yum install postgresql-devel -y

sudo yum install gcc -y

pip3 install --user psycopg2

```

##### 2.1)安装完毕后运行python3,然后import psycopg2,若没有报错,则说明psycopg2安装成功。

##### 1.3)运行\q退出psql客户端。

## `**************作业2:请如上图一样将regression表的查询命令、输出结果和退出psql以后的界面截图,并插入实验报告***************`

#### 2)使用`Python`+`psycopg2`访问。很多时候我们需要在程序中访问数据仓库,比如用Python读取DW中的数据,然后进一步操作。我们可以通过使用`psycopg2`来实现访问。运行以下命令安装`psycopg2`package。

```

sudo yum install python3-devel -y

sudo yum install postgresql-libs -y

sudo yum install postgresql-devel -y

sudo yum install gcc -y

pip3 install --user psycopg2

```

##### 2.1)安装完毕后运行python3,然后import psycopg2,若没有报错,则说明psycopg2安装成功。

##### 2.2)quit()退出python3命令行,让我们运行几个Python代码来实现建表,插入,查询等操作。

> 建立createTable.py文件,并复制如下代码。其中username,password,hostIP,port都要替换成你的数据仓库参数。

```

import psycopg2

conn = psycopg2.connect(database="dev", user="username", password="password", host="hostIP", port="port")

cur = conn.cursor()

cur.execute('CREATE TABLE COMPANY (ID INT PRIMARY KEY NOT NULL,\

NAME TEXT NOT NULL,\

AGE INT NOT NULL,\

ADDRESS CHAR(10),\

SALARY REAL);')

conn.commit()

conn.close()

```

> 运行createTable.py,如果没有报错,则说明建表成功。

```

python3 createTable.py

```

> 向COMPANY表中添加一些记录。建立insertTable.py文件,复制如下代码并运行。

```

import psycopg2

conn = psycopg2.connect(database="dev", user="username", password="password", host="hostIP", port="port")

cur = conn.cursor()

cur.execute("INSERT INTO COMPANY VALUES (1, 'Paul', 32, 'California', 20000.00 )");

cur.execute("INSERT INTO COMPANY VALUES (2, 'Allen', 25, 'Texas', 15000.00 )");

cur.execute("INSERT INTO COMPANY VALUES (3, 'Eric', 35, 'Florida', 25000.00 )");

conn.commit()

conn.close()

```

> 让我们查询一下刚刚建的表。建立selectTable.py文件,复制如下代码并运行。

```

import psycopg2

conn = psycopg2.connect(database="dev", user="username", password="password", host="hostIP", port="port")

cur = conn.cursor()

cur.execute("SELECT id, name, address, salary from COMPANY order by id")

rows = cur.fetchall()

print ("ID NAME ADDRESS SALARY")

for row in rows:

print (row[0], "\t", row[1], "\t", row[2], "\t", row[3])

conn.close()

```

> 你应该会看到如下输出。

##### 2.2)quit()退出python3命令行,让我们运行几个Python代码来实现建表,插入,查询等操作。

> 建立createTable.py文件,并复制如下代码。其中username,password,hostIP,port都要替换成你的数据仓库参数。

```

import psycopg2

conn = psycopg2.connect(database="dev", user="username", password="password", host="hostIP", port="port")

cur = conn.cursor()

cur.execute('CREATE TABLE COMPANY (ID INT PRIMARY KEY NOT NULL,\

NAME TEXT NOT NULL,\

AGE INT NOT NULL,\

ADDRESS CHAR(10),\

SALARY REAL);')

conn.commit()

conn.close()

```

> 运行createTable.py,如果没有报错,则说明建表成功。

```

python3 createTable.py

```

> 向COMPANY表中添加一些记录。建立insertTable.py文件,复制如下代码并运行。

```

import psycopg2

conn = psycopg2.connect(database="dev", user="username", password="password", host="hostIP", port="port")

cur = conn.cursor()

cur.execute("INSERT INTO COMPANY VALUES (1, 'Paul', 32, 'California', 20000.00 )");

cur.execute("INSERT INTO COMPANY VALUES (2, 'Allen', 25, 'Texas', 15000.00 )");

cur.execute("INSERT INTO COMPANY VALUES (3, 'Eric', 35, 'Florida', 25000.00 )");

conn.commit()

conn.close()

```

> 让我们查询一下刚刚建的表。建立selectTable.py文件,复制如下代码并运行。

```

import psycopg2

conn = psycopg2.connect(database="dev", user="username", password="password", host="hostIP", port="port")

cur = conn.cursor()

cur.execute("SELECT id, name, address, salary from COMPANY order by id")

rows = cur.fetchall()

print ("ID NAME ADDRESS SALARY")

for row in rows:

print (row[0], "\t", row[1], "\t", row[2], "\t", row[3])

conn.close()

```

> 你应该会看到如下输出。

## `**************作业3:请将运行selectTable.py的命令和输出结果截图,并插入实验报告***************`

### 三)使用MADlib完成简单的机器学习任务(线性回归)

#### 1)前面我们说过,在Greenplum中使用MADlib插件可以直接在DW中建立机器学习模型。这里我们用二)中的regression表跑一下线性回归算法。请使用psql或者psycopg2登录数仓,并运行如下命令。

```

SELECT madlib.linregr_train (

'regression', -- source table

'regression_model', -- output model table

'y', -- dependent variable

'ARRAY[1, x1, x2]' -- independent variables

);

```

> 这里我们看到使用了MADlib的线性回归模型linregr_train来对regression表中的数据进行训练,模型输入变量为x1, x2以及偏置项,输出变量为y。训练好的模型保存在regression_model表中。

### 2)让我们看下模型表中有什么,运行以下命令

```

SELECT * FROM regression_model;

```

> 可能输出比较乱,你可以运行以下命令,让表的结果竖起来。

```

\x

SELECT * FROM regression_model;

```

> 这样是不是顺眼多了 :ghost: :ghost: :ghost: 我们看到了线性回归模型的参数以及标准差,p-value等指标的值

## `**************作业3:请将运行selectTable.py的命令和输出结果截图,并插入实验报告***************`

### 三)使用MADlib完成简单的机器学习任务(线性回归)

#### 1)前面我们说过,在Greenplum中使用MADlib插件可以直接在DW中建立机器学习模型。这里我们用二)中的regression表跑一下线性回归算法。请使用psql或者psycopg2登录数仓,并运行如下命令。

```

SELECT madlib.linregr_train (

'regression', -- source table

'regression_model', -- output model table

'y', -- dependent variable

'ARRAY[1, x1, x2]' -- independent variables

);

```

> 这里我们看到使用了MADlib的线性回归模型linregr_train来对regression表中的数据进行训练,模型输入变量为x1, x2以及偏置项,输出变量为y。训练好的模型保存在regression_model表中。

### 2)让我们看下模型表中有什么,运行以下命令

```

SELECT * FROM regression_model;

```

> 可能输出比较乱,你可以运行以下命令,让表的结果竖起来。

```

\x

SELECT * FROM regression_model;

```

> 这样是不是顺眼多了 :ghost: :ghost: :ghost: 我们看到了线性回归模型的参数以及标准差,p-value等指标的值

### 3)最后让我们用这个模型去做预测。我们直接在训练集上进行预测。你会看到如下输出,其中predict是预测结果,observation是原始的y值。

```

\x

SELECT regression.*,

madlib.linregr_predict ( ARRAY[1, x1, x2], m.coef ) as predict,

y as observation

FROM regression, regression_model m;

```

### 3)最后让我们用这个模型去做预测。我们直接在训练集上进行预测。你会看到如下输出,其中predict是预测结果,observation是原始的y值。

```

\x

SELECT regression.*,

madlib.linregr_predict ( ARRAY[1, x1, x2], m.coef ) as predict,

y as observation

FROM regression, regression_model m;

```

### 4)运行\q退出psql客户端。

## `**************作业4:请如上图一样把预测结果和退出psql以后的界面一起截图,并插入实验报告***************`

### 4)运行\q退出psql客户端。

## `**************作业4:请如上图一样把预测结果和退出psql以后的界面一起截图,并插入实验报告***************`